Ricerca “Epic-Kitchens: avvicinare l’Intelligenza artificiale alla realtà”

La visione artificiale potrebbe rivoluzionare tutti gli aspetti della vita quotidiana: dallo shopping alle cure mediche, ai trasporti. Le applicazioni future di una ricerca pionieristica che coinvolge anche l’Università di Catania

Un grande set di dati di ricerca sulla visione in prima persona per studiare e sviluppare algoritmi utili a realizzare un “assistente artificiale” capace di comprendere in tempo reale le azioni che compiamo e di riconoscere gli oggetti che utilizziamo. Ma anche di comunicare eventuali rischi a cui si potrebbe andare incontro compiendo alcune azioni.

È quanto prevede il progetto Epic-Kitchens avviato nel 2018 dall’Università di Bristol in Gran Bretagna (prof. Dima Damen) con il contributo dei ricercatori degli atenei di Catania (i docenti Giovanni Maria Farinella e Antonino Furnari) e Toronto (prof. Sanja Fidler) e che segna un momento cruciale nel campo della visione e dell’intelligenza artificiale in quanto è diventato il più grande set di dati di ricerca sulla visione in prima persona con quasi 5mila download provenienti da 42 paesi e oltre 350 citazioni in documenti accademici in soli 3 anni.<

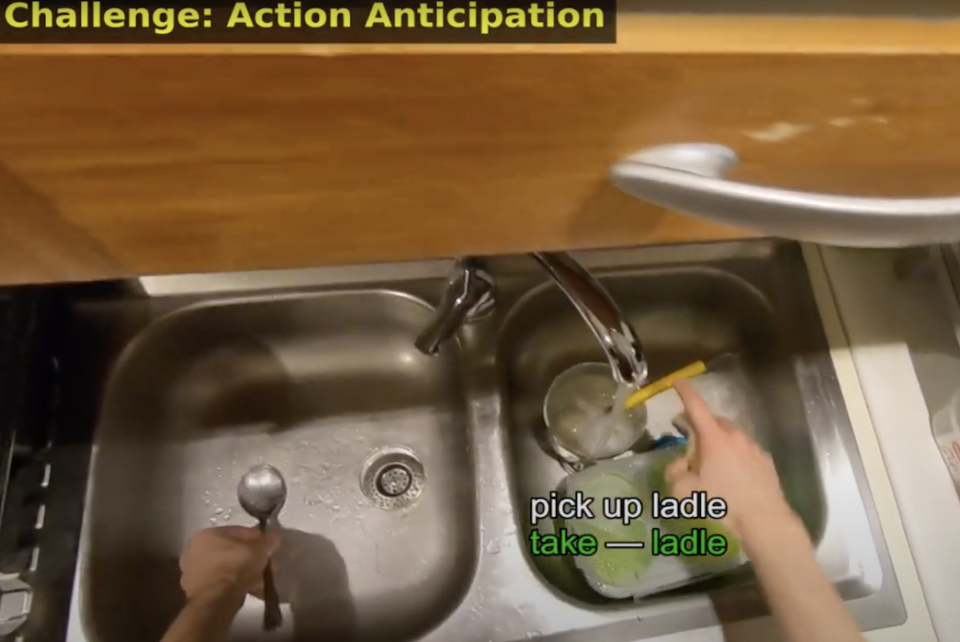

«L’obiettivo del progetto Epic-Kitchens è proprio quello di permettere alla comunità scientifica di riferimento di poter avere non solo i dati, ma anche produrre risultati sperimentali fornendo alcune challenge specifiche per cui sono stati definiti formalmente i problemi come anche le metriche utile a valutare e comparare gli algoritmi» aggiunge il dott. Antonino Furnari, ricercatore che ha contribuito alla definizione e allo studio del problema di anticipazione delle azioni.

Il dataset Epic-Kitchens conta più di 20 milioni di fotogrammi di immagini, 90mila azioni diverse e 20mila narrazioni uniche in più lingue. Alla base del progetto – che ha anche attirato l’attenzione della Defense Advanced Research Projects Agency (DARPA), l’agenzia governativa del Dipartimento della Difesa degli Stati Uniti incaricata dello sviluppo di nuove tecnologie per uso militare – la cattura e l’elaborazione delle attività quotidiane in cucina delle persone nelle proprie case. Un progetto pionieristico che avrà, e sta già avendo, un impatto significativo sull’evoluzione della tecnologia di visione artificiale.

In una prima fase sono stati coinvolti 32 partecipanti dei 3 Paesi coinvolti nella ricerca che grazie ad una telecamera montata sulla testa hanno catturato ogni azione manuale intrapresa nella propria cucina. Ai partecipanti è stato chiesto di registrare tutto in maniera naturale e senza alcun vincolo di copione: dalla preparazione del caffè al lavaggio dei piatti, dal tagliare le verdure allo svuotamento dei rifiuti. Acquisito il video, a ogni partecipante è stato chiesto di guardarlo e di utilizzare una interfaccia appositamente sviluppata per creare un’annotazione dell’azione eseguita consentendo al team di ricerca di assegnare a ciascuna azione un’etichetta che sta alla base del set di dati.

La ricerca di Epic-Kitchens segna in particolare una svolta nella modalità di raccolta dei dati nel contesto della visione artificiale: non sono le persone ad essere registrate mentre eseguono un’azione da una terza telecamera posizionata nell’ambiente; è l’azione eseguita dalla persona ad essere registrata in prima persona grazie alle telecamere montate sulla testa dei partecipanti.

La ricerca ha prodotto anche alcuni risultati anche grazie al fatto che i video hanno anche una componente audio, per cui si è riusciti a fornire maggiori dettagli alle registrazioni consentendo ad esempio di capire automaticamente se un rubinetto fosse in funzione o se si stesse tagliando una patata o una cipolla. Epic-Kitchens, quindi, non è solo un set di dati per comprendere le azioni in cucina, ma permette ai ricercatori di sviluppare modelli di intelligenza artificiale utili alla comprensione dei video in generale.

A distanza di tre anni dall’avvio, il progetto Epic-Kitchens ha costituito la base di numerose altre ricerche in tutto il mondo. Il set di dati originale è stato ampliato e anche il numero delle challenge è cresciuto incoraggiando i ricercatori a trovare nuove soluzioni ai problemi complessi posti alla visione artificiale.

Il progetto, anche se pionieristico, ha contribuito a ridurre il divario tra dove si trova il mondo oggi con la tecnologia e dove vogliamo arrivare. Diversi sono i progetti in ambito nazionale e internazionale che impiegano tecnologie di visione artificiale su dispositivi indossabili in cui il gruppo del prof. Farinella sta fornendo contributi che prevedono un impatto in ambito industriale e il trasferimento tecnologico.

«In alcuni contesti specifici, come ad esempio quello in cui operano persone in una fabbrica, è già possibile implementare alcune funzionalità, come ad esempio quella di comprendere le interazioni degli operatori con gli oggetti per prevedere eventuali rischi e incidenti sul lavoro – spiega il prof. Giovanni Maria Farinella -. Sebbene abbiamo ottenuto risultati soddisfacenti in alcuni contesi e sono arrivati riconoscimenti importanti, c’è ancora molta strada da fare prima di poter pensare di indossare un assistente artificiale sempre in grado di vedere e capire cosa siamo in grado di fare noi umani. Non abbiamo mai smesso di credere nella possibilità di creare algoritmi e tecnologie che possano essere utili per supportare l’uomo nella vita di tutti i giorni. Pensiamo che i dispositivi di visione indossabili possano fornire il giusto punto di vista per far questo».

Il video ufficiale con cui è stato lanciato il nuovo set di dati esteso è disponibile al seguente link: https://youtu.be/8IzkrWAfAGg